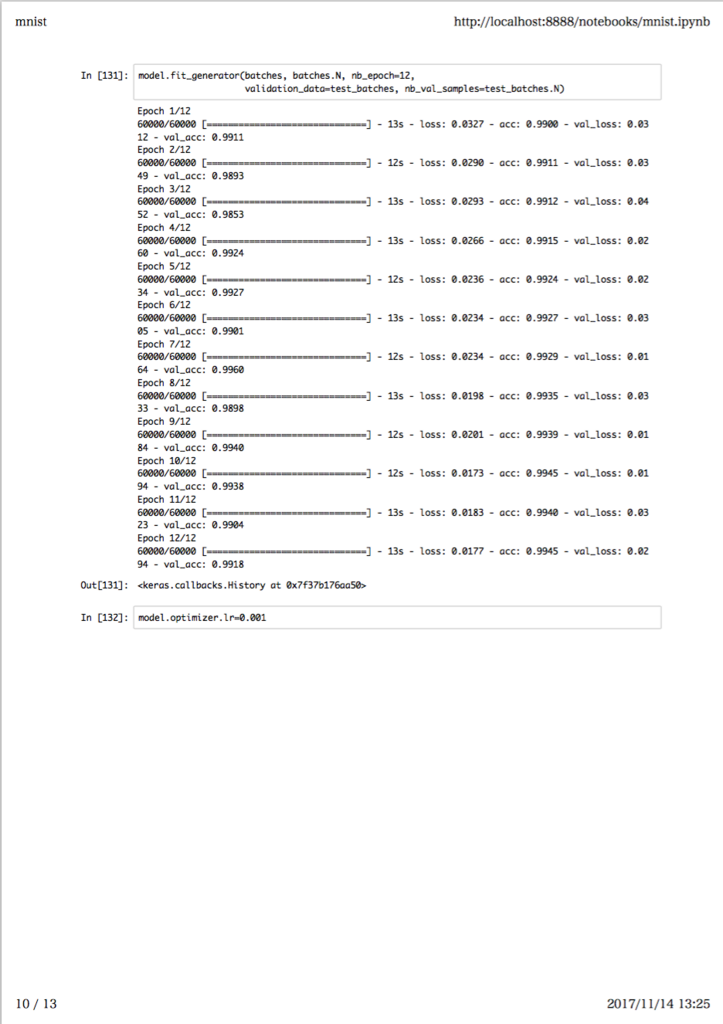

Jupyter Notebookを印刷するときにレスペーパー化する

fast.aiの Practical Deep Learning for Coders は Jupyter Notebookで教材が提供されています。 コードは紙に出力したい派なのでipynbファイルを紙に印刷してそれを見ながら勉強しています。

ただ、

以下のようなTraining時の長い出力がダラダラと含まれていたりで

俯瞰できずに読みにくいし、印刷ページも無駄に増えて何か勿体ない ! ><

というのがあり、印刷時に不必要な部分をカットできるツールを作りました。

具体的には Trainingの出力のうち、最初と最後のepochの出力だけを残して後はカットします。

このツールを使うと、先ほどのページが

というような感じになり、とてもスッキリ〜 ( •ᴗ•)

MNISTのノートブック、mnist.ipynb が 何と 13ページ → 8ページ に! w

印刷代も30円節約できます。。

いきなりHerokuにRailsアプリがデプロイできなくなった..

密かに運営している POG集計サービス「Poger mailing service」の中で行っているスクレイピング処理が今日から誤動作し始めちゃいました。。

これはhtmlの出力仕様が変わったに違いない! (当たり)

急いで不具合を修正して、

Herokuに git push heroku master でいつものようにデプロイしたら

Unable to negotiate a key exchange method

というエラーが出てデプロイできなくなってしまった..! Oh, my god...

何だコレ?

エラーメッセージで検索してみると 公式ページに 「弱い暗号化アルゴリズムは使えなくした」とある。

https://devcenter.heroku.com/changelog-items/1311

We strengthened the SSH transport for our Git service by disabling the following algorithms:

解決法

$ brew install openssh

で解決 !!

ふぅ、焦った。。

スマートビームレーザーがすごい

超小型レーザープロジェクター Smart BEAM Laser を買いました。

これがめっちゃよい

焦点調整不要! 電源ケーブル不要! 無線接続で投影可能! ƪ(•◡•ƪ)"

画質はそこそこですが他の方のレビューでもかなり評判高いです。

- 未来すぎるモバイルプロジェクター、Smart Beam Laserの紹介とレビュー | RentioPress

- 手のりモバイルレーザープロジェクターの衝撃「Smart Beam Laser」(いしたにまさき) - 個人 - Yahoo!ニュース

- 混沌の屋形風呂: モバイルレーザープロジェクターが街歩きの必需品に!

無線接続の仕方

公式のFAQページでも書いてありますが iOS と Android で 使用モードが異なる ので注意! (モード切り替えは電源ボタンを2回連続押し)

少しハマってしまいました。。

分かりにくいですね..

iOS (iPad)

- Media Sharing モード にする

- WiFi は SMARTBEAMLASER-○○ につないでおく

- 起動したアプリから AirPlay する

Android

- Media Mirroring モード にする

- WiFiはONにする (無線機器につながっていなくてもok)

- Miracast する (使い方は機種によって大分違う。マニュアルを見るべし)

- 4GやWiFiつないだ状態でも使える

Android だと 4GやWiFiつないだ状態でもミラーリングができるので YouTubeなどオンラインコンテンツも投影できます。Google Play等で購入したビデオは再生するのにインターネット接続が必要なのでこれはありがたいです ( •ᴗ•)

台形補正

アプリストアから「SmartBeamLaser」アプリをインストールすると台形補正ができます。 これで上下方向±15°くらいは補正できます。補正できるレンジは大きくなく、斜めの投影は補正できないのでおまけの域は出ませんがないよりはいいかなと思います。

アプリは Media Sharingモードじゃないと本体に繋がらないので Android のときは切り替えが必要でやや面倒です。

あと、メニュー画面を見ても分かるようにアプリがあると音量もコントロールできます。

Amazonの星の評価...

今回、Amazonで買ったのですがショップから評価依頼が来てビックリ。

一般的なAmazonの評価基準につきましては、 良いと思われる場合は、星5つ 普通と思われる場合は、星4つ 悪いと感じられた場合は、星3つ 非常に悪い場合には、星2もしくは1が、一般的なAmazonでの評価と判断されます。

え、普通が 4 なんですか?!

マジ?

星3つが普通だと思っているたくさんの人がいてここに星4つを普通だとする人が混ざってくると、みんなが「普通」だと思っているものが 3.0ではなく 3.0 + α と評価がかさ上げされてしまう... ╰(゚x゚)╯

Amazon、恐ろしい。。

fast.aiでTensorFlowをバックエンドとして使う

fast.ai はKerasのバックエンドとしてTheanoを前提としていますがTensorFlowも使うことができます。

~/.keras/keras.json を

{

"image_dim_ordering": "tf",

"epsilon": 1e-07,

"floatx": "float32",

"backend": "tensorflow"

}

とすればTensorFlowになり、特にエラーもなくJupyter Notebookを実行できます。

が、

これだけではうまくいきません。。

なぜか、学習したときの精度が低くなっちゃう.. ><

Lesson1のThe punchline: state of the art custom model in 7 lines of codeを実行すると、

| Theano | TensorFlow |

|---|---|

| val_acc: 0.9825 | val_acc: 0.9190 |

となります。。

原因

VGG16モデルの転移学習用の重みデータ vgg16.h5 と vgg16_bn.h5 が Theano用になっているからです。

KerasのWikiページ Converting convolution kernels from Theano to TensorFlow and vice versa · fchollet/keras Wiki · GitHub に重みファイルの変換の方法が記載されていますが

どうやらKeras v2用のコードのようでfast.aiで使用するKeras v1だとエラーになります。

Keras v1での重み変換

ここのコードを参考にしてうまく変換できました。:-)

実装したものはこちら gist.github.com

このコードで作った vgg16.tf.h5 を vgg16.h5 の代わりに使うようにして TensorFlow バックエンドで学習を実行すると、

| Theano | TensorFlow(重み変換前) | TensorFlow(重み変換後) |

|---|---|---|

| val_acc: 0.9825 | val_acc: 0.9190 | val_acc: 0.9840 |

期待通りの精度が出るようになりました。( •ᴗ•)

utils.py の修正とバックエンド切り替えスクリプト

このままでは Theano と TensorFlow のバックエンドを頻繁に変えたいときに面倒なので utils.py を少し修正します。

== 46行目あたり ==

if K.backend() == 'theano':

import theano

from theano import shared, tensor as T

from theano.tensor.nnet import conv2d, nnet

from theano.tensor.signal import pool

のように修正し、バックエンドが Theano のときだけ Theanoのライブラリを読み込むようにします。

さらに、次のようなシェルスクリプトを作ると

switch_keras_backend.sh

#!/bin/bash if [ $# -ne 1 ]; then echo "ERROR: Wrong arguments" echo "Usage: switch_keras_backend.sh th|tf" exit 1 fi if [ $1 != 'th' ] && [ $1 != 'tf' ]; then echo "ERROR: Wrong parameter. Parameter must be 'th' or 'tf'." echo "Usage: switch_keras_backend.sh th|tf" exit 1 fi backend=$1 if [ $backend = 'th' ]; then echo "Use theano as backend" elif [ $backend = 'tf' ]; then echo "Use tensorflow as backend" fi cd ~/.keras ln -nsf keras.$backend.json keras.json cd ~/.keras/models ln -nsf vgg16.$backend.h5 vgg16.h5 ln -nsf vgg16_bn.$backend.h5 vgg16_bn.h5 echo 'Done!'

重みファイルも簡単に切り替えができます。

( vgg16.h5 と keras.json はそれぞれのバックエンド毎に用意したファイルへのシンボリックリンクにしておく必要あり)

Theanoのインストール

fast.ai の Practical Deep Learning For Coders, Part 1 は Keras v1(バックエンドはTheano)を使用します。

なので、早速 Ubuntu14.04に Theanoをインストールしていきます。

インストール

公式ページ に書いてある通り、以下の1行で楽々インストール

$ conda install theano pygpu

.theanorcに手こずった..

しかし、やはりというか設定関係で少し苦労..。

ubuntu14.04 theanoとかgpgpu環境構築メモ - 備忘録とか日常とか を参考にして

cnmen = True

としたら ValueError: could not convert string to float: True というエラーが出た。。

どうやら cnmem = True とするのはTheano 0.7までのときの設定のようで Theano 0.8からは

cnmem = 1 のように float型の値を入れるらしい。

https://github.com/Theano/Theano/issues/4170

ところが、cnmem = 1 としたら先のエラーは解消したもののconvolutionを使った学習実行時に

RuntimeError: ('The following error happened while compiling the node', GpuDnnSoftmax{tensor_format='bc01', mode='channel', algo='log'}(GpuContiguous.0), '\n', 'could not create cuDNN handle: CUDNN_STATUS_INTERNAL_ERROR')

という新たなエラーが...! (。ŏ﹏ŏ)

いろいろ試してみると cnmem = 0〜0.9 までだったら問題ないことが分かりました。

公式ページの http://deeplearning.net/software/theano_versions/0.9.X/library/config.html#config.config.lib.cnmem を読む限りは

cnmem = 1 や cnmem = 0.95 でも設定としては大丈夫そうなのだが..

CNMeM

cnmem = 0 (CNMeM is disabled)がよいのか? cnmem = 0.9 (CNMeM is enabled with initial size: 90.0% of memory)がよいのか?

公式ページによると

Controls the use of CNMeM (a faster CUDA memory allocator). Applies to the old GPU backend CUDA backend up to Theano release 0.8.

This could cause memory fragmentation. So if you have a memory error while using CNMeM, try to allocate more memory at the start or disable it. If you try this, report your result on :reftheano-dev.

とあり、

- CNMeMを使うとCUDAのメモリ割り当てが早くなる

- ただし、メモリの断片化を引き起こす可能性がある

とのことです。

自分の環境(GeForce GTX 950)でLesson1の「The punchline: state of the art custom model in 7 lines of code」 のコードを使って比較してみたところ

| cnmem = 0 (CNMeM disabled) | cnmem = 0.9 (CNMeM enabled) |

|---|---|

| 約806s / epoch | 約785s / epoch |

と 実際に CNMeMを有効にしたほうが速くなりました。:-)

Making Theano Faster with CuDNN and CNMeM on Windows 10 – Ankivil の記事でも CNMeM + CuDNN が速いという報告になっています。(赤い実線に注目)

(図は https://ankivil.com/wp-content/uploads/2016/08/cuddn_cnmem_combined_graph_vgg16.png から引用)

(図は https://ankivil.com/wp-content/uploads/2016/08/cuddn_cnmem_combined_graph_vgg16.png から引用)

AWSのGPUインスタンスを立てる

ちょっと前からfast.ai が提供しているディープラーニング学習のオンラインコース、Practical Deep Learning For Coders, Part 1を始めています。

このコースはためになり面白い! ƪ(•◡•ƪ)"

(Udacityのコースより全然よい。しかも無料)

しかし、

自宅マシンのスペックが非力(メインメモリ8GB、GPUメモリ2GB)なため課題の途中でMEMORY ERRORの嵐。。(◞‸◟)

FloydHubはプロモーション期間が10/1で終了してしまいGPU無料枠を失ってしまいましたが UdacityのDeep Learning Nanodegreeを受講したときの特典、AWS100ドルクーポンがまだ残ってる!

fast.aiのgithubのレポジトリにはAWSのセットアップスクリプトが含まれています。若干の改造が必要でしたが超簡単にGPUインスタンスが使えるようになりました。:-)

なお、fast.aiのコースの内容についてはこのブログが大変参考になります。

スクリプトの改修点

setup_p2.sh

EC2インスタンスを作成するスクリプトです。そのまま実行すると、

Only us-west-2 (Oregon), eu-west-1 (Ireland), and us-east-1 (Virginia) are currently supported

というエラーが出ちゃいました。。

なので、強制的にOregonリージョンを使うようにしました。

# get the correct ami #export region=$(aws configure get region) export region='us-west-2' export AWS_DEFAULT_REGION='us-west-2'

これでものの数分でP2インスタンスが起動できちゃいます。

P2インスタンスのコスト(2017/10/6時点)

P2インスタンスは東京リージョンでも使えるようになったのでスクリプトを修正すれば東京リージョンでも起動できると思いますが以下のようにコストが1.7倍するので学習用である限りは東京リージョンで使うのをやめたほうがいいと思います

| リージョン | P2インスタンスのコスト |

|---|---|

| 米国東部 バージニア北部(us-east-1) | $0.9 |

| 米国東部 オハイオ(us-east-2) | $0.9 |

| 米国西部 オレゴン(us-west-2) | $0.9 |

| 欧州アイルランド(eu-west-1) | $0.972 |

| 欧州フランクフルト(eu-central-1) | $1.362 |

| アジアパシフィック ソウル(ap-northeast-2) | $1.465 |

| アジアパシフィック 東京(ap-northeast-1) | $1.542 |

| アジアパシフィック シドニー(ap-southeast-2) | $1.542 |

| アジアパシフィック シンガポール(ap-southeast-1) | $1.718 |

| アジアパシフィック ムンバイ(ap-south-1) | $1.542 |

aws-alias.sh

setup_p2.shを実行すると fast-ai-commands.txtというファイルが作成され、その中で設定すべき環境変数が記述されているのですが.bash_profileなどに書き写すのに少し抵抗があり、これを自動的に設定するようにしました。

以下のコードを先頭に足します。

export AWS_DEFAULT_REGION='us-west-2' eval $(grep -e "^export" fast-ai-commands.txt)

これでaws-alias.shを実行したとき、必要な環境変数が自動的に設定されてます。

ただ、このままでは aws-alias.shで定義されている aws-ssh 等がなぜかうまく動きません...

$instanceIpが x.x.x.xのようになっているべきところ、"x.x.x.x"とダブルクォーテーションがついてしまっているのが原因でした。

なので、これを取り除くように修正します。( | sed -e "s/\"//g"を追加します)

# Original #alias aws-start='aws ec2 start-instances --instance-ids $instanceId && aws ec2 wait instance-running --instance-ids $instanceId && export instanceIp=`aws ec2 d escribe-instances --filters "Name=instance-id,Values=$instanceId" --query "Reser vations[0].Instances[0].PublicIpAddress"` && echo $instanceIp' # 修正版 alias aws-start='aws ec2 start-instances --instance-ids $instanceId && aws ec2 w ait instance-running --instance-ids $instanceId && export instanceIp=`aws ec2 de scribe-instances --filters "Name=instance-id,Values=$instanceId" --query "Reserv ations[0].Instances[0].PublicIpAddress" | sed -e "s/\"//g"` && echo $instanceIp' # Original #alias aws-ip='export instanceIp=`aws ec2 describe-instances --filters "Name=ins tance-id,Values=$instanceId" --query "Reservations[0].Instances[0].PublicIpAddre ss"` && echo $instanceIp' # 修正版 alias aws-ip='export instanceIp=`aws ec2 describe-instances --filters "Name=inst ance-id,Values=$instanceId" --query "Reservations[0].Instances[0].PublicIpAddres s" | sed -e "s/\"//g"` && echo $instanceIp'

これで、一度 source aws-alias.sh したあと、aws-start、aws-ssh、aws-stopのコマンドで楽にEC2インスタンスの制御とsshログインができます。

簡単にP2インスタンスが起動できちゃうので使いすぎに注意ですね。。

Jupyter Notebook起動時に求められるパスワードは Lesson1のNote に記載されており、 dl_course です。

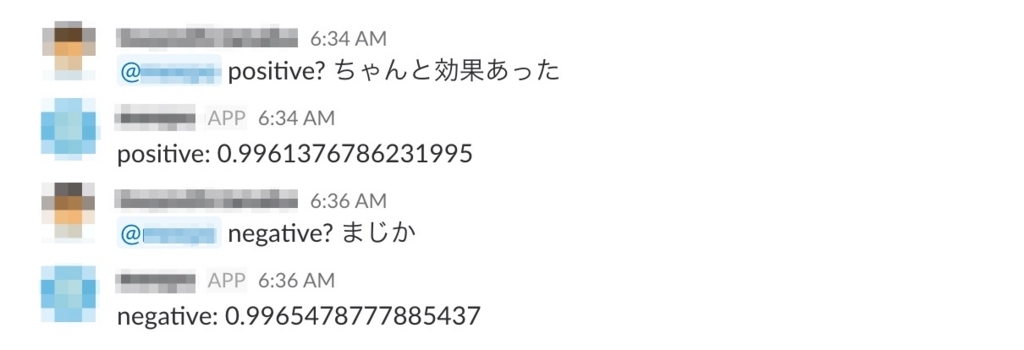

Slackメッセージの感情分析

前の記事に引き続き、Slackメッセージの感情分析を行います。

メッセージの収集

まずはSlackメッセージの収集からです。

Slackチャネル上に飛び交うメッセージをログングするボットを作成し、対象チャネルにinviteしてメッセージを収集します。

ボットはhubotで作りました。

ロギングするスクリプトは以下で、これを scripts/ディレクトリに配置しておきます。

=== logger.coffee ===

LOG_DIR = 'log'

fs = require('fs')

util = require('util')

dateFormat = require('dateformat')

unless fs.existsSync(LOG_DIR)

fs.mkdirSync(LOG_DIR)

module.exports = (robot) ->

robot.hear /.*/, (res) ->

msg = res.match

today = dateFormat(new Date(), "yyyymmdd")

logfile = util.format('%s/%s.txt', LOG_DIR, today)

fs.appendFile logfile, msg + "\n", 'utf8', (err) ->

if err

console.log(err)

このボットはメッセージをひっそりせっせとログファイルに保存し続けます。:-)

データセットの作成

続いて、ここが最も肝心なデータセットの構築です。

入力メッセージと出力ラベルの組をどうするか?

例えば、次のようにメッセージとリアクションのやり取りがあったとします。

ログファイルには次のように記録されます。

ありがとうございます:angel: :smile: :+1:

コメントに対するリアクション③(:tada:)は残念ながら記録されません.. ><

また、このボットが複数チャネルでメッセージ収集している場合、

ありがとうございます:angel: :smile: 何か他の話題のメッセージ :+1:

と①と④の間に他の話題のメッセージが混入してくる場合があります。

なので、①と④を入力メッセージと出力ラベルの組とすることは難しく、①と②を入力とラベルの組としました。

データ数を増やすという意味では (①, ③)や(①, ④)の組み合わせも含めたかったです...

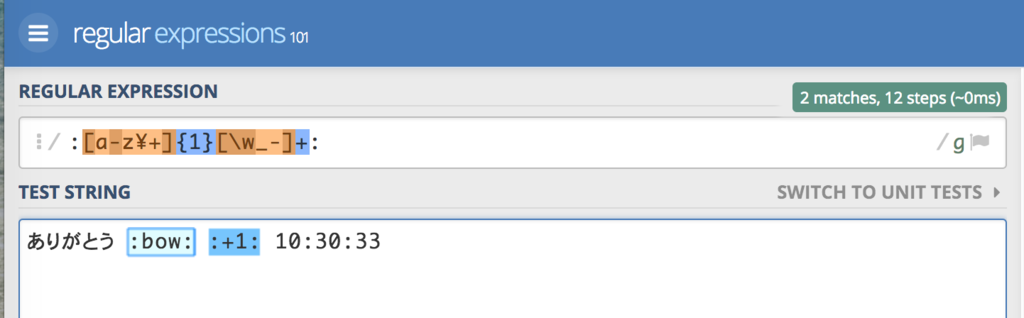

基本的なアルゴリズム

メッセージ部分とラベル部分に分ける

リアクション文字は

:pray:、:sob:のように:何とか:というようになっています。 正規表現':[a-z\+]{1}[\w_-]+:'でこのパターンを取り出します。'ありがとうございます'と[:angel:, :smile:]に分割します。正規表現のテストは https://regex101.com/ が役に立ちました。

MeCabでメッセージ部分を単語に分割する

'ありがとうございます'は['ありがとう', 'ござい', 'ます']と3つの単語に分割されますメッセージとラベルの組を作る

- メッセージ部分:

['ありがとう', 'ござい', 'ます'] - ラベル部分:

[:angel:, :smile:]

から

['ありがとう', 'ござい', 'ます']->:angel:['ありがとう', 'ござい', 'ます']->:smile:

という2つの組を作ります

- メッセージ部分:

ラベルのマージ

最初は メッセージ -> リアクション という予測ができると面白いなと考えていましたが ラベルの数のばらつきが大きいため難しそうでした。

【理由】ラベル数の分布に大きな偏りがあると最も数が多いラベルのみを出力するようにネットワークが学習されてしまいます

なので、ラベルをマージして positive か negative かの2種類になるようにしました。

変換テーブルの例

| 元ラベル | 変換後 |

|---|---|

:smile: :smile: |

positive |

:tada: :tada: |

positive |

:sob: :sob: |

negative |

:scream: :scream: |

negative |

:bow: :bow: |

(なし) |

は "ごめんなさい"(negative)の意味で使われること以外にも "よろしくお願いします" の意味でも使われるので マッピングなし としました。(このようなリアクションは:bow:以外にもいくつかあります)

は "ごめんなさい"(negative)の意味で使われること以外にも "よろしくお願いします" の意味でも使われるので マッピングなし としました。(このようなリアクションは:bow:以外にもいくつかあります)

マージすることで入力とラベルが同じになった組はさらに1つにまとめます。

学習

サンプル数

46449メッセージから学習用と検証用のデータセットを構築しました。

| 学習データセット(90%) | 検証用データセット(10%) |

|---|---|

| 1048 | 117 |

それぞれ positive と negative が 半々ずつ含まれています。

positive、negativeに分類できるリアクション絵文字を含む文 となるとかなり少なくなってしまいました。。⊂(¯×¯٥)⊃

パラメータ

前回やったときとパラメータを少し変えましたがそれ以外は同じです。

- seq_len: 30

- hidden_unit: 300

結果

5〜10 epoch学習して 65〜70%の正解率となりました。(データ数が少ないせいかばらつき大きいです) 同じラベルを常に出力する あるいは完全にランダムに出力する と 約50% になるはずなので一応は感情を捉えていると思います。

あらためて入力データを眺めてみると、人間が見ても positive なのか negative なのか 分からない入力もたくさんありました..。

判断が難しいメッセージの例

| 入力メッセージ | 正解ラベル |

|---|---|

| 冬 よ 来い | positive |

| 経由 で | negative |

| 待機 | positive |

| つくら ね ば | negative |

今回はデータ数が少なくて精度がイマイチというのもありますがSlackコミュニケーションの特性上、文脈が複数に分かれたメッセージとしてやり取りされるのでこのまま単純にデータ数を増やすだけでは精度は改善しないかもしれません。。

しかし、、データ集めるの難しいですね。。

判定ボット

せっかくなのでボットで判定できるようにしました ƪ(•◡•ƪ)"